Moltbot : L'assistant IA autonome qui bouleverse les règles du jeu (et inquiète les experts en sécurité)

En une semaine, Moltbot a accumulé 116 000 étoiles GitHub et provoqué la rupture de stock des Mac Mini. Analyse complète de cet assistant IA révolutionnaire qui peut agir à votre place, et des risques de sécurité qui inquiètent les experts.

Créé par Peter Steinberger — le développeur autrichien derrière PSPDFKit — Moltbot n'est pas un chatbot de plus. C'est ce que la communauté tech appelle désormais "Claude avec des mains" : une IA qui ne se contente pas de répondre, mais qui agit.

Qu'est-ce que Moltbot exactement ?

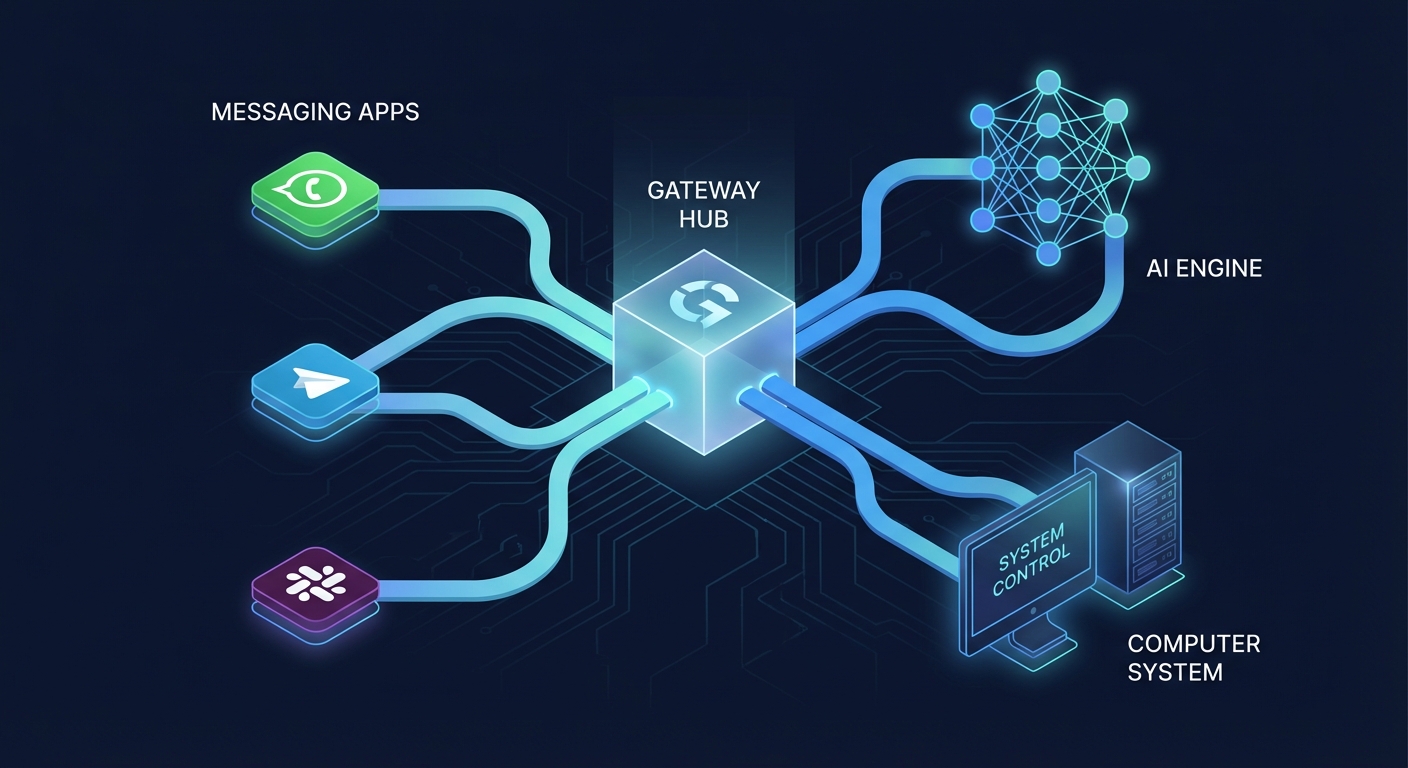

Moltbot est un assistant IA personnel auto-hébergé qui s'intègre directement aux applications de messagerie que vous utilisez déjà : WhatsApp, Telegram, Slack, Discord, Signal, iMessage, ou Microsoft Teams.

Caractéristiques distinctives

| Fonctionnalité | Description |

|---|---|

| Mémoire persistante | Conserve le contexte entre les sessions, contrairement aux chatbots classiques |

| Exécution locale | Tourne sur votre machine (Mac, Linux, Windows via WSL2, Raspberry Pi) |

| Actions autonomes | Peut exécuter des commandes shell, naviguer sur le web, gérer fichiers et emails |

| Proactivité | Envoi d'alertes, rappels et briefings sans intervention manuelle |

| Skills extensibles | Marketplace de compétences additionnelles (ClawdHub) |

Cas d'usage concrets rapportés par la communauté

- Réservation intelligente : Appel téléphonique automatisé pour réserver un restaurant quand OpenTable n'est pas disponible

- Audiobooks personnalisés : Génération de livres audio sur mesure

- Domotique avancée : Contrôle de thermostats basé sur la météo et les préférences

- Impression 3D : Gestion de file d'attente avec alertes de complétion

- Santé connectée : Analyse quotidienne des données WHOOP (récupération, sommeil, effort)

- Meal prep automatisé : Planification de repas avec commande automatique des courses

Architecture technique

Moltbot repose sur une architecture gateway qui fait le pont entre vos applications de messagerie et un modèle de langage de votre choix (Claude, GPT-4, Gemini, ou modèles locaux via Ollama).

Installation

L'installation se fait en une commande :

# macOS / Linux

curl -fsSL https://molt.bot/install.sh | bash

# Puis lancement de l'assistant d'onboarding

moltbot onboard --install-daemonPrérequis : Node.js 22+, une clé API pour le LLM choisi (Anthropic, OpenAI, etc.)

Coûts estimés

Moltbot lui-même est gratuit (licence MIT). Les coûts proviennent des API :

- Usage léger (quelques commandes/jour) : 10-30€/mois

- Usage modéré (tâches régulières) : 30-70€/mois

- Usage intensif : 100€+/mois

⚠️ Le revers de la médaille : Les risques de sécurité

C'est là que le tableau s'assombrit. Plusieurs firmes de cybersécurité — Palo Alto Networks, Cisco, 1Password, Hudson Rock, Intruder, Bitdefender — ont tiré la sonnette d'alarme.

Les vulnérabilités identifiées

1. Exposition des instances

Des chercheurs ont découvert via Shodan des centaines d'instances Moltbot exposées sur internet, dont certaines sans aucune authentification, donnant accès complet aux commandes et données de configuration.

2. Stockage des credentials en clair

Les identifiants et tokens sont stockés en fichiers texte bruts dans ~/.clawdbot/ — une aubaine pour les malwares voleurs de données comme RedLine, Lumma ou Vidar.

3. Injection de prompts via messages

Un attaquant peut envoyer un message WhatsApp ou Telegram contenant des instructions malveillantes cachées. Grâce à la mémoire persistante de Moltbot, ces instructions peuvent être exécutées des jours plus tard quand le contexte s'y prête — une forme d'attaque différée difficile à détecter.

4. Absence de sandboxing par défaut

L'agent a les mêmes accès que l'utilisateur sur le système : fichiers, shell, emails, APIs. Un prompt malicieux peut donc potentiellement supprimer des fichiers ou exfiltrer des données sensibles.

"Mon modèle de menace n'est pas votre modèle de menace, mais il devrait l'être. N'exécutez pas Clawdbot."

— Heather Adkins, VP Security Engineering chez Google Cloud

Comment déployer Moltbot de manière (plus) sécurisée

Si malgré les risques vous souhaitez expérimenter, voici les bonnes pratiques :

1. Isolation

- Exécuter dans une machine virtuelle ou un conteneur Docker

- Utiliser un VPS dédié plutôt que votre machine principale

- Configurer le sandboxing natif

{

"agents": {

"defaults": {

"sandbox": {

"mode": "all",

"scope": "session",

"workspaceAccess": "ro"

}

}

}

}2. Réseau

- Ne jamais exposer les ports admin sur internet

- Utiliser Tailscale ou un tunnel SSH pour l'accès distant

- Configurer un firewall strict

3. Authentification

- Activer systématiquement l'authentification du gateway

- Utiliser le mode "pairing" pour les DM

4. Skills

- Auditer manuellement chaque skill avant installation

- Désactiver la fonctionnalité si non gouvernable

Verdict : Innovation fascinante, prudence de rigueur

Moltbot représente indéniablement une avancée significative dans l'interaction homme-machine. L'idée d'un assistant IA qui vit dans nos applications de messagerie existantes et peut réellement agir en notre nom est séduisante.

Cependant, le projet illustre parfaitement la tension entre ergonomie et sécurité. En supprimant délibérément les garde-fous pour maximiser l'utilité, Moltbot crée une surface d'attaque considérable.

Pour qui ?

✅ Recommandé : Développeurs expérimentés, environnements sandboxés, expérimentation personnelle sur machine isolée

❌ Déconseillé : Environnements professionnels, utilisateurs sans expertise sécurité, machines contenant des données sensibles

L'avenir

Moltbot (désormais aussi appelé OpenClaw suite à un nouveau rebranding) pose les bases de ce que seront les assistants IA de demain. La question n'est pas si nous aurons des agents autonomes, mais comment les sécuriser.

Comme le résume 1Password :

"La sécurité des agents ne consiste pas à accorder un accès une fois. Il s'agit de médiatiser continuellement l'accès au runtime pour chaque action."

📚 Sources

- GitHub — Dépôt officiel Moltbot

- Scientific American — Moltbot is an open-source AI agent that runs your computer

- The Register — Clawdbot becomes Moltbot, but can't shed security concerns

- Palo Alto Networks — Why Moltbot May Signal the Next AI Security Crisis

- Cisco Security Blog — Personal AI Agents like Moltbot Are a Security Nightmare

- Bleeping Computer — Viral Moltbot AI assistant raises concerns over data security

- 1Password — It's incredible. It's terrifying. It's OpenClaw.

- Platformer — Falling in and out of love with Moltbot

- DEV Community — Moltbot: The Ultimate Personal AI Assistant Guide for 2026

- DataCamp — Moltbot (Clawdbot) Tutorial: Control Your PC from WhatsApp

- DigitalOcean — Moltbot Quickstart Guide

Articles similaires

La dette technique de l'IA : le vrai coût du code généré

84% des développeurs utilisent l'IA pour coder. Mais selon GitClear, la duplication de code a été multipliée par 8. Entre gains de productivité et dette technique explosive, où est le vrai bilan ?

2025, l'année où les développeurs ont appris à douter de l'IA

Bilan d'un développeur freelance après trois ans à coder avec l'IA. En 2025, l'adoption explose mais la confiance chute. Entre promesses non tenues et gains réels, où en sommes-nous vraiment ?